人工智能卷积神经网络-卷积神经网络算法 java

文章目录

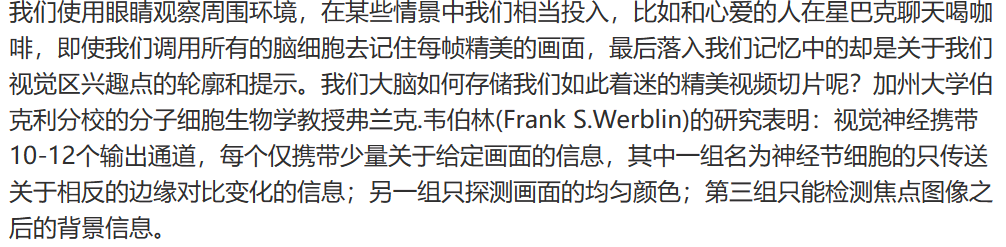

动物视觉神经,以及脑科学

引自:

视网膜——视觉第一站

光信号转换成电信号

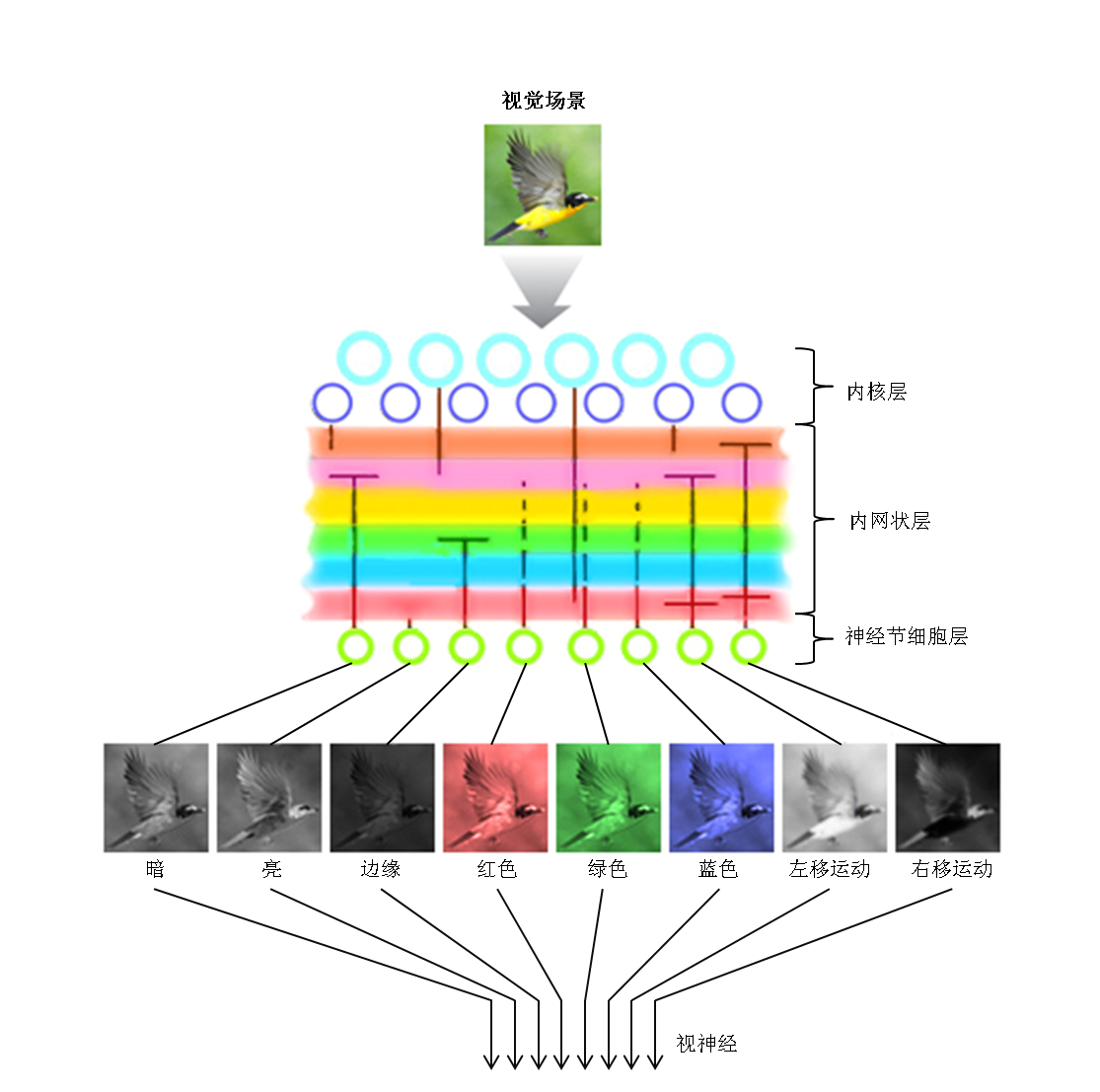

视网膜中的神经元,根据不同的形态和功能主要分为五大类:光感受器、双极神经元细胞、神经节细胞、水平细胞、无长突细胞

简单来说,前一级神经元的电活动促使其分泌特定的化学物质(即神经递质)并作用在下一级神经元上进而引起下一级神经元电活动的变化。

有的神经递质可以增强下一级神经元的电活动,有的神经递质则会抑制下一级神经元的电活动,比如双极神经元释放的神经递质可以增强神经节细胞的电活动,而无长突细胞释放的递质可以抑制神经节细胞的电活动。

一种简单的模型是说,光感受器将信息传递给十多个亚型的双极细胞人工智能卷积神经网络,可以理解为十多条并行的通路,这十多条通路在对视觉信息进行平行传递时由水平细胞和无长突细胞进行加工处理,最终将视觉信息的不同要素(比如明暗变化,颜色,运动速度与方向等)抽提出来传递给不同亚型的神经节细胞。

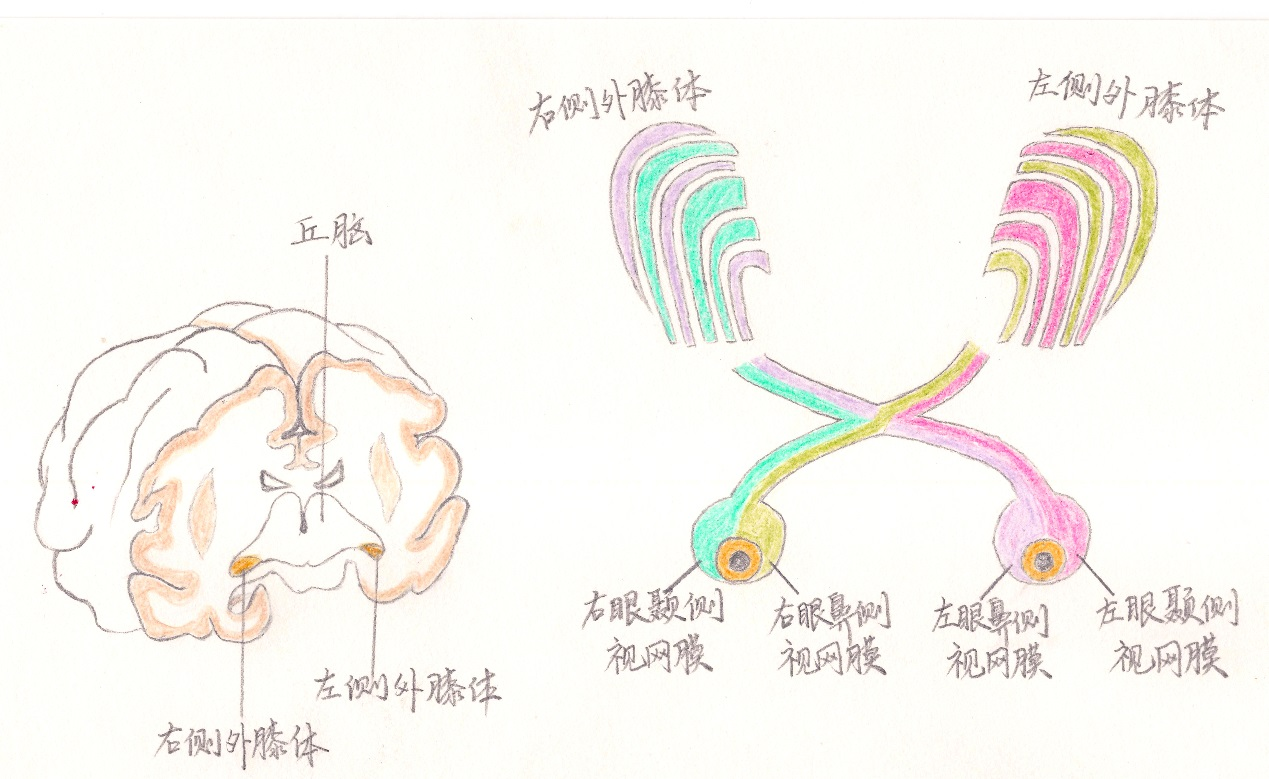

外膝体——信息中转站

外膝体类似于视网膜,其中的神经元也是规则地分层排列,不同类型的神经元分布在不同分层,接收不同亚型的视网膜神经节细胞的输入,再将这些信息传输给初级视皮层。

外膝体中大约25%的中间神经元,一方面接收视网膜神经节细胞的指令,另一方面同时接收视皮层的反馈,作用则是调节其他神经元的电活动。这里就出现了另外一个科学家们在20世纪晚期才注意到的重要现象,视皮层接收外膝体中继细胞的信息之后,会反过来就外膝体进行负反馈的调节。就像一个系统,有兴奋就需要有抑制,有正反馈就需要有负反馈,这样才有可能使系统保持相对的稳定而不至于能量无限的增益直至衰竭崩溃。所以,像前文提到过的中间神经元可以抑制其他神经元的电活动、高级皮层可以对低级脑区进行负反馈调节,这些都是使得神经系统可以正常工作的重要功能。

视网膜应用多条平行通路进行信息的传递和处理,同样的,视觉信息在脑内的处理过程也有类似的平行模式,即不同性质的视觉信息成分经不同的神经环路通道预处理,最终由不同性质的皮层细胞来分别进行分析处理与整合。目前的证据表明,中枢视觉信息的处理既是由低级向高级逐步升级的过程,又遵循着平行处理的原则。而外膝体作为视觉信息的中转站,在平行信息处理通道中起到了关键的作用,将不同细胞种类的平行通道、左右眼信息通道、空间频率通道、颜色信息处理通道、空间方位信息通道、运动方位信息通道等分别传送到专门处理这些信息的皮层神经元。

视皮层——中央处理器

在神经系统这部“巅峰之作”中,大脑皮层的形成可称为“画龙点睛之笔”。进化过程中哺乳动物才开始出现的皮层结构,在学习记忆、语言思考以及知觉意识等高级功能方面发挥着至关重要的作用,且越是高等的生物,其皮层的结构和功能则越是发达。

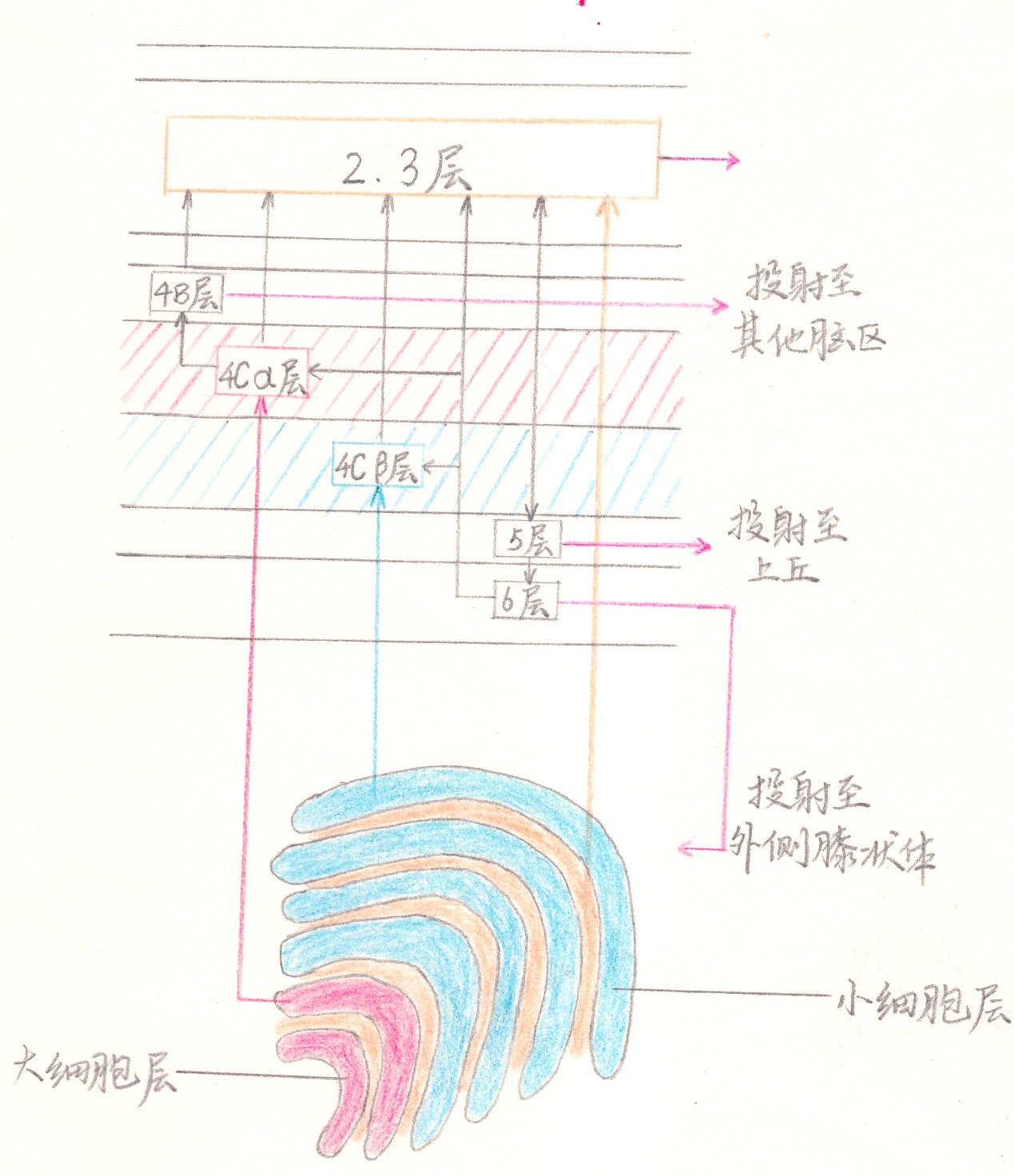

图:外侧膝状体至初级视皮层各层的投射关系、初级视皮层内部的投射关系及初级视皮层向外侧膝状体、上丘及其他皮层区域的投射关系。

(张雯孙新尧绘制,修改自《Principles of neuralscience》第5版572页,原文处标注经许可修改自Blasdel和Lund1983)

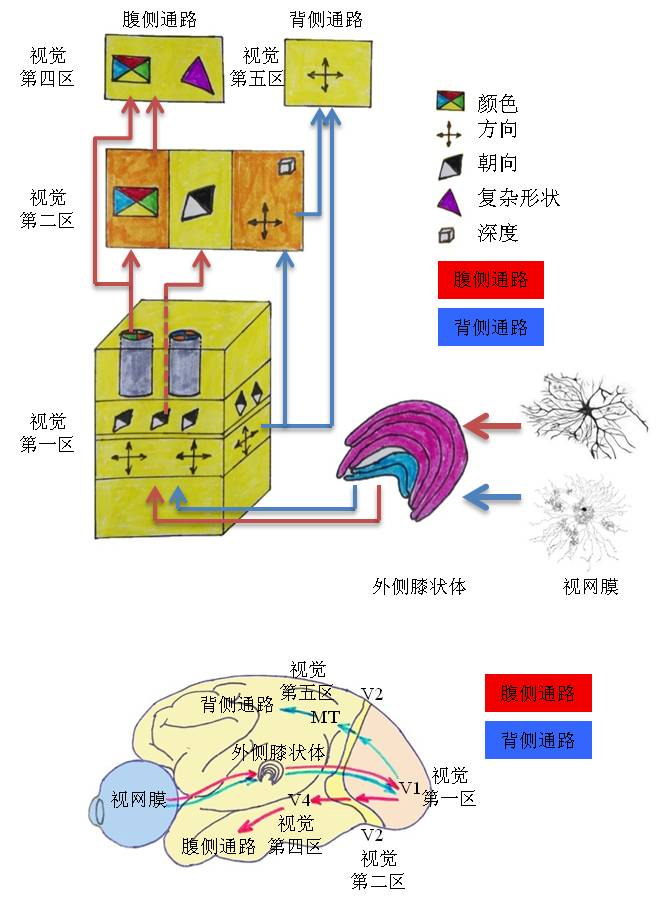

通常所说的视皮层主要包括初级视皮层(又称作纹状皮层或视觉第一区域,即V1)和纹外皮层(例如视觉第二、第三、第四、第五区域等,即V2、V3、V4、V5)。

有一种模型认为,整个的皮层信息处理过程由两条并行的通路完成:

视觉通路的平行处理模型。主要分为背侧通路和腹侧通路。

(周桢宁 绘制,修改自《Principles of neural science》第5版571页, 原文处标注经许可图中所示视网膜神经节细胞的形态使用了Dennis Dacey的实验数据)

Hubel和Wiesel根据对视觉刺激的反应特征,在视皮层发现了多种神经元,分别叫做简单细胞、复杂细胞以及超复杂细胞。

并证实了皮层功能柱的结构:许多具有相同特性的皮层细胞,在视皮层内按照一定的规则在空间上排列起来,这种按功能排列的皮层结构人工智能卷积神经网络,即皮层的功能构筑,沿着皮层的不同层次呈现柱状分布

小tips

人工神经网络

原文链接:

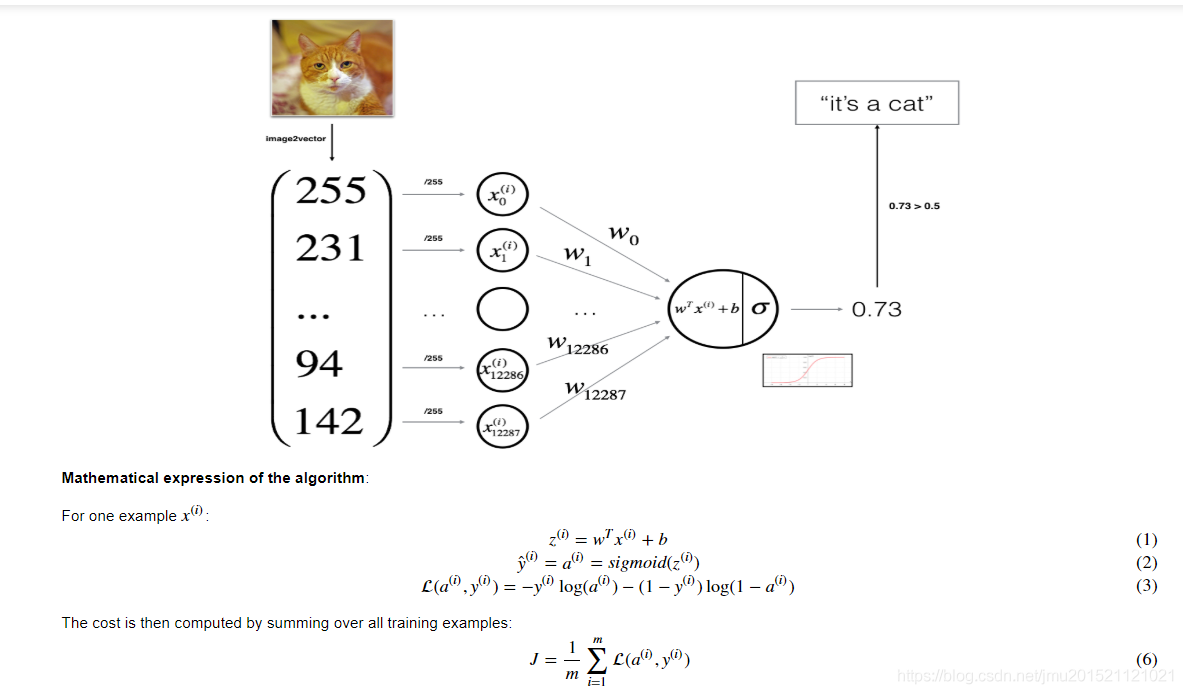

人们根据脑神经科学,设计出了人工神经元。

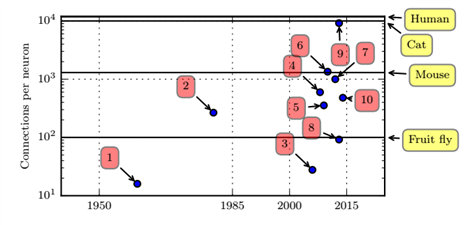

人工神经元的连接数随着时间的推移,呈现出快速增长的趋势

自适应线性单元 (Widrow and Hoff, 1960)神经认知机 (Fukushima, 1980)GPU-加速 卷积网络 (Chellapilla et al., 2006)深度玻尔兹曼机 (Salakhutdinov and Hinton, 2009a)无监督卷积网络 (Jarrett et al., 2009b)GPU-加速 多层感知机 (Ciresan et al., 2010)分布式自编码器 (Le et al., 2012)Multi-GPU 卷积网络 (Krizhevsky et al., 2012a)COTS HPC 无监督卷积网络 (Coates et al., 2013)GoogLeNet (Szegedy et al., 2014a)

纵轴是神经元数量

神经认知机模型

这是一种分层神经网络模型。

神经认知机模型由如下三个细胞层组成:

S细胞层和C细胞层交替排列的结构。会将底层提取的局部特性逐渐变成全局特性。

通过引入神经网络中的误差反向传播算法,人们得出卷积神经网络。

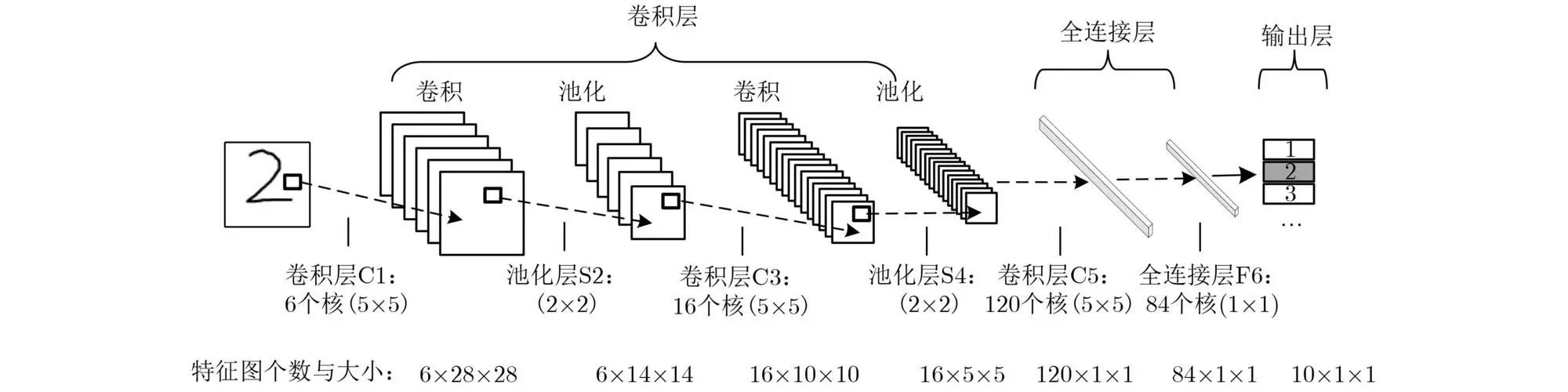

卷积神经网络结构(Convolutional Neural Network,CNN)

卷积神经网络由以下层组成

通过增加卷积层和池化层,还可以得到更深层次的网络。

全连接层可以采用多层结构。

卷积层

[ 原理在这里不再阐述 ]

需要注意的点:

卷积层用于提取物体特征,多种不同的卷积核可以提取出的特征信息

(详细内容参考 《计算机视觉》 方面的内容)在卷积层的误差传播中,卷积核中的数据即为 权重 www ,因此反向误差传播调整的权重即为卷积核内数据。 池化层

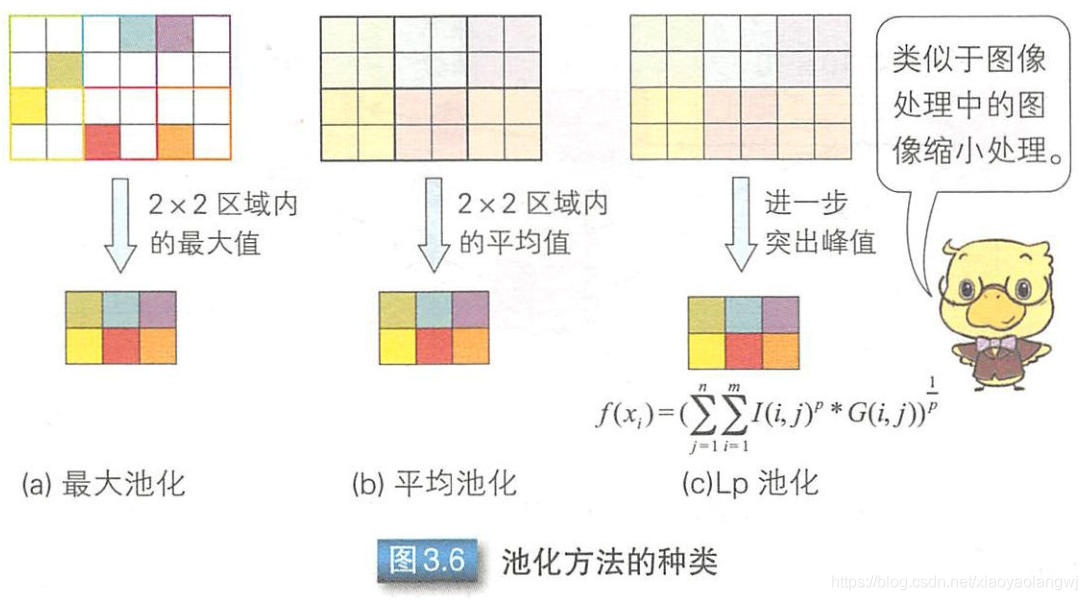

池化层的作用是 减少卷积层产生的特征图的尺寸。

池化操作降低了特征值的维度,使得特征表示对输入数据的位置变换具有稳健性。

主要池化方法:

全连接层

全连接层中的每个神经元与其前一层的所有神经元进行全连接.全连接层可以整合卷积层或者池化层中具有类别区分性的局部信息

输出层

与多层感知层的输出层一样,卷积神经网络的输出层也是使用似然函数计算各类别的似然概率

softmax函数

在视觉识别中常使用softmax函数。

p(yk)=exp(u2k)∑q=1Qexp(u2q)p(y^k) = \frac{exp(u_{2k})}{\sum_{q=1}^Q exp(u_{2q})}p(yk)=∑q=1Qexp(u2q)exp(u2k)

线性输出函数

在递归问题中,一般使用线性输出函数计算各单元的输出值。

p(yp)=∑m=1Mwpmxmp(y^p) = \sum_{m=1}^M w_{pm}x_mp(yp)=m=1∑Mwpmxm

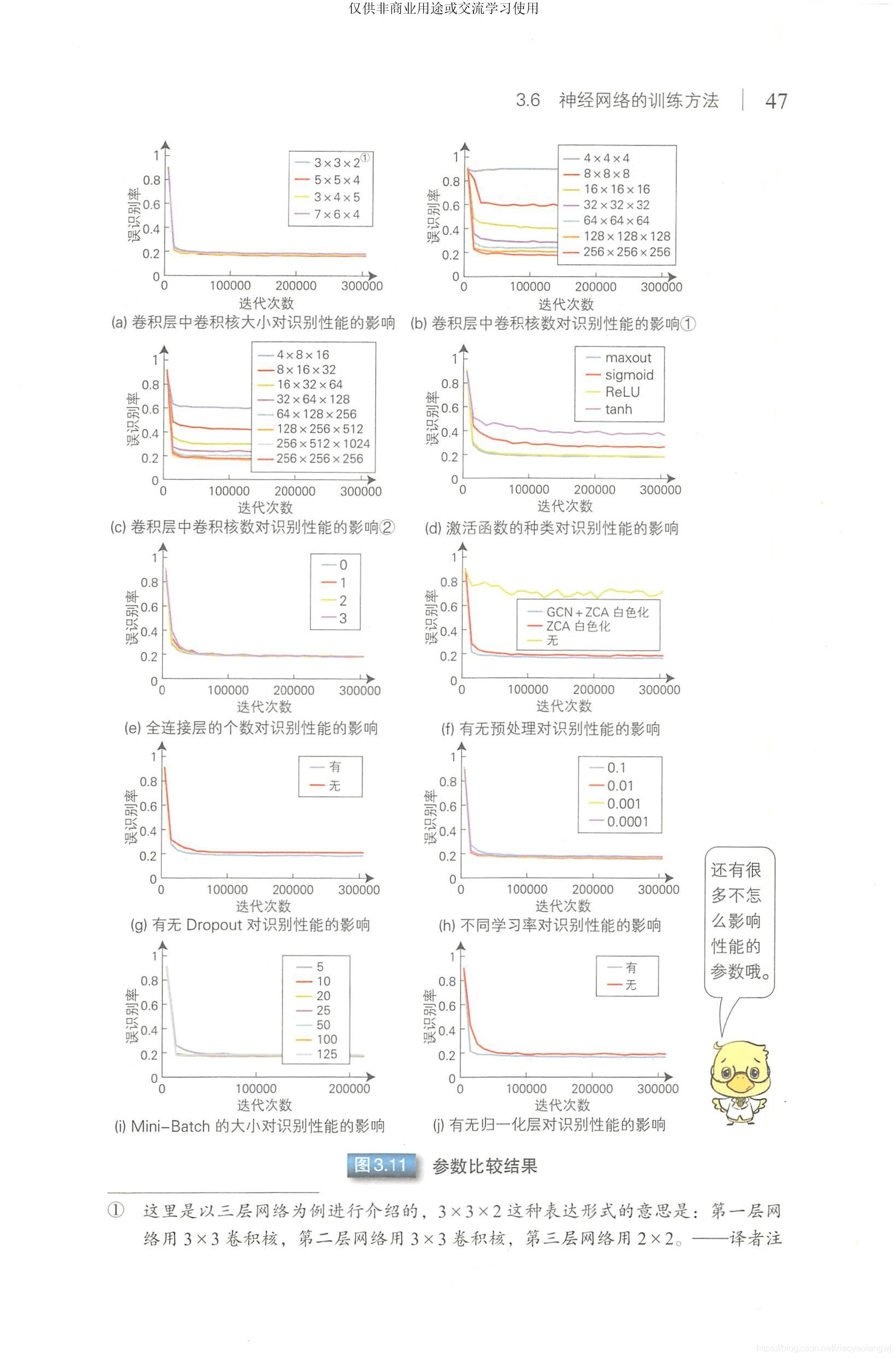

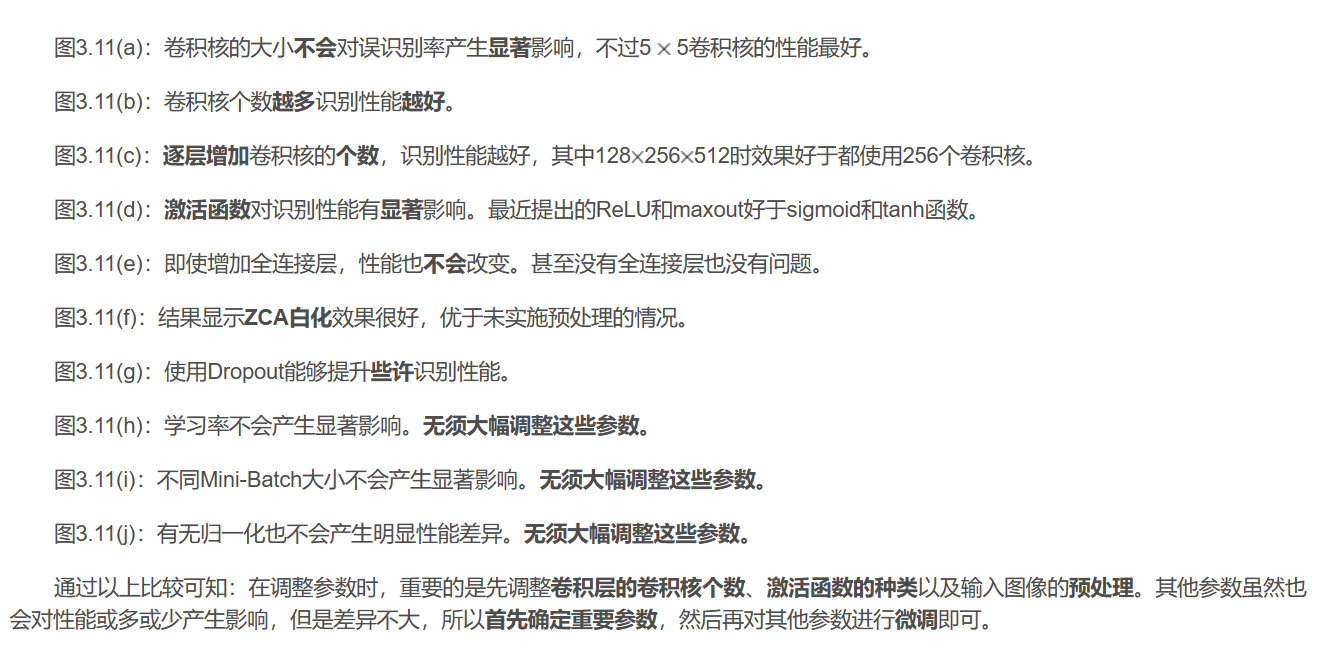

神经网络的训练方法 卷积神经网络中的调整参数

卷积神经网络的参数包括:

误差更新使用误差反向传播算法训练

卷积神经网络中的预设参数

与神经网络有关的主要参数

与训练有关的参数

根据CIFAR-10数据集,比较各参数对神经网络学习能力的学习情况

CIFAR-10 数据集简介

CIFAR-10 是由 Hinton 的学生 Alex Krizhevsky 和 Ilya Sutskever 整理的一个用于识别普适物体的小型数据集。一共包含 10 个类别的 RGB 彩色图 片:飞机( a叩lane )、汽车( automobile )、鸟类( bird )、猫( cat )、鹿( deer )、狗( dog )、蛙类( frog )、马( horse )、船( ship )和卡车( truck )。图片的尺寸为 32×32 ,数据集中一共有 50000 张训练圄片和 10000 张测试图片。

引自:《图解深度学习》学习笔记(二)

上一篇

上一篇